2025年7月,华为盘古大模型涉嫌套壳阿里云Qwen大模型的风波,再次将”套壳”这一争议性话题推向风口浪尖。这场风波不仅揭示了大模型行业的技术依赖现状,更折射出整个AI领域在快速发展过程中面临的创新困境与伦理挑战。

回溯大模型发展历程,”套壳”现象经历了从简单API封装到复杂数据蒸馏的演变过程。2022年底ChatGPT引爆全球AI热潮后,国内涌现出数百个”山寨版”ChatGPT,这些早期套壳产品大多只是简单包装OpenAI的API接口,通过前端界面改头换面后以会员制形式牟利。这种低技术含量的”套壳”行为很快遭到监管打击,上海熵云网络科技有限公司就因运营”ChatGPT在线”公众号被罚款6万元,成为国内首个因”套壳”行为受罚的案例。

随着行业发展,”套壳”行为逐渐从简单的接口封装转向更隐蔽的数据利用。2023年,包括讯飞星火、DeepSeek V3在内的多个大模型被曝出在对话中表现出”ChatGPT特征”,引发套壳质疑。这些现象背后,是模型训练过程中对ChatGPT生成数据的隐性依赖——即通过”数据蒸馏”技术,利用更强大模型(如GPT-4)生成的高质量问答数据来微调自家模型。这种做法虽在技术上存在争议,却被业内视为提升模型性能的”捷径”。

2023年12月,外媒曝光字节跳动利用OpenAI API训练自家模型的事件,将”套壳”争议推向新高度。尽管字节跳动辩称这是技术团队的实验性项目,且未计划上线使用,但该事件暴露了一个残酷现实:在基础架构层面无法套壳OpenAI产品的情况下,数据层面的”借力”成为众多企业的现实选择。这种灰色地带的操作,既反映了技术研发的现实困境,也凸显了行业标准的缺失。

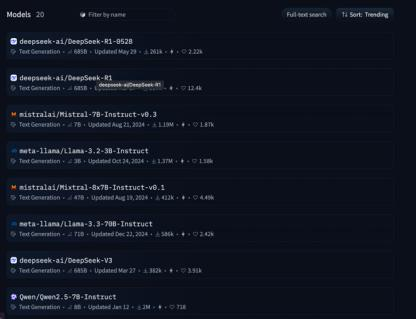

开源时代的到来,使”套壳”争议进入新阶段。Meta开源LLaMA 2后,百余款国产模型基于此进行微调上线。这种基于开源架构的二次开发,模糊了”借鉴”与”抄袭”的界限。零一万物Yi-34B模型被指仅修改变量名就宣称原创的事件,引发了对开源协议边界的热烈讨论。Hugging Face工程师Arthur Zucker认为,LLaMA开源协议主要限制模型权重而非架构,因此这类修改不构成侵权。这一观点虽从法律角度提供了解释,却未能平息业界对技术伦理的质疑。

更极端的案例来自斯坦福大学LLaMA3V模型事件。该团队宣称用500美元训练出SOTA多模态模型,后被发现与中国企业面壁智能的MiniCPM-LLaMA3-V 2.59高度雷同。这种几乎原封不动的”套壳”行为最终导致团队删库跑路,但也引发了对开源社区透明度的深刻反思。当技术创新沦为”重新包装”的游戏,开源精神的核心价值——协作与共享——将面临严峻挑战。

面对愈演愈烈的”套壳”争议,行业专家提出了不同视角的解读。叶知秋认为,关键在于是否以原生模型名义发表成果,以及是否在技术文档中明确说明改进点。他强调,基于开源架构的”演化”与”加训”不应简单等同于套壳,但必须遵守学术诚信原则。法律界人士秦朝则指出,当前界定套壳与抄袭存在举证难题,特别是当涉及多家技术来源时,法律追责往往滞后于技术发展。

这场争议背后,折射出中国AI行业面临的深层困境。一方面,基础模型研发需要巨额投入和长期积累,中小团队难以承担;另一方面,市场竞争压力迫使企业追求快速产出,导致技术捷径成为”理性选择”。百度李彦宏”不必重复发明轮子”的观点,代表了行业对技术分工的现实考量。然而,当”套壳”成为普遍现象,行业将陷入同质化竞争的恶性循环。

展望未来,大模型行业的发展需要在技术创新与伦理规范之间寻找平衡点。建立更清晰的技术边界、完善开源协议执行机制、加强学术诚信建设,或许能为行业指明方向。正如叶知秋所言,开源本身不是问题,关键在于企业是否诚实披露技术来源。在AI技术日新月异的今天,唯有坚持自主创新与开放协作并重,中国大模型行业才能真正实现从”跟跑”到”领跑”的跨越。

这场”套壳”争议不会轻易平息,但它无疑将成为中国AI发展历程中的重要转折点——促使整个行业重新思考创新的本质与边界,在借鉴与原创之间找到可持续发展的道路。